GPT-4V, finalizzato nel 2022 e presentato nel 2023, incarna l'armonia tra tecnologia ed etica. Questa incarnazione di intelligenza artificiale è stata forgiata con un occhio critico verso le complessità della multi modalità e le insidie delle inferenze infondate (allucinazioni).

Multi modalità significa che il modello può maneggiare una varietà di dati - dal testo alle immagini, dai suoni alle intricate combinazioni di questi che espongono a jailbreak multimodali che sono tentativi di compromettere il sistema, esplorando le sue vulnerabilità durante il trattamento di dati complessi, con l'intento di provocare comportamenti non previsti o indesiderati. In mezzo a queste dinamiche, GPT-4V si erge, non solo come un prodotto di ingegneria sofisticata, ma anche come un baluardo di principi etici, delineando un percorso che altri sono chiamati a seguire.

Ops… sono inciampato sulla radice di un albero, cadendo in un buco che mi ha trasportato in un mondo incantato di unicorni e arcobaleni. No, non sono io fare la sviolinata, è ciò che scrive OpenAI nel paper per presentare la sua ultima creatura. GPT-4V (Vision) rappresenta la capacità dell'AI di vedere e comprendere un'immagine. Nulla di nuovo se pensi alla ricerca di Pinterest, Google Lens o a come l'algoritmo rotto di Facebook modera le immagini, ma ora è possibile farlo eseguire quasi qualsiasi task attraverso prompt.

Data la portata della democratizzazione della Computer Vision e i rischi che comporta, e considerando che potenzialmente l’OSINT (open source intelligence) è alla portata di chiunque sia maleintenzionato e “veda” tutte le foto in massa sul web in tempo reale per colpire chiunque ne riveli troppo e mostri vulnerabilità, non mi sorprende che si focalizzino sulla sicurezza. Vediamo ora cosa hanno da dirci e anche qualche caso d’uso che ho messo insieme per voi.

Questo è un articolo pubblico; per vedere più casi studio ed esperimenti, potete iscrivervi alla Community AI Warrios qui.

Sicurezza e Mitigazioni

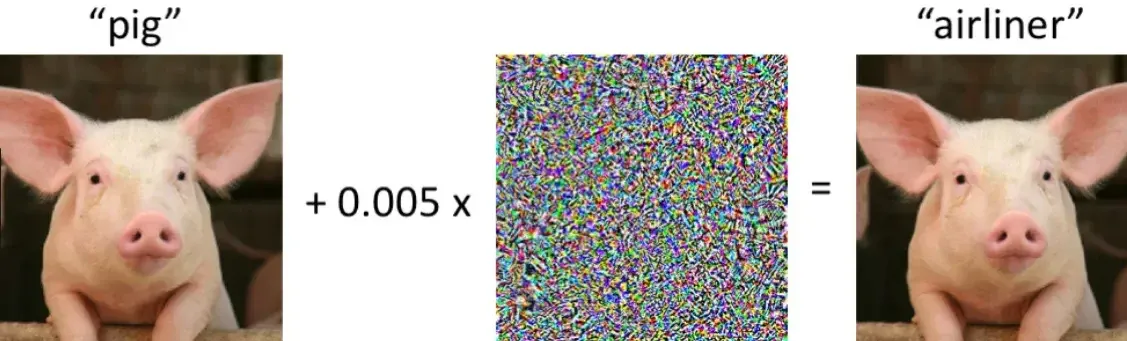

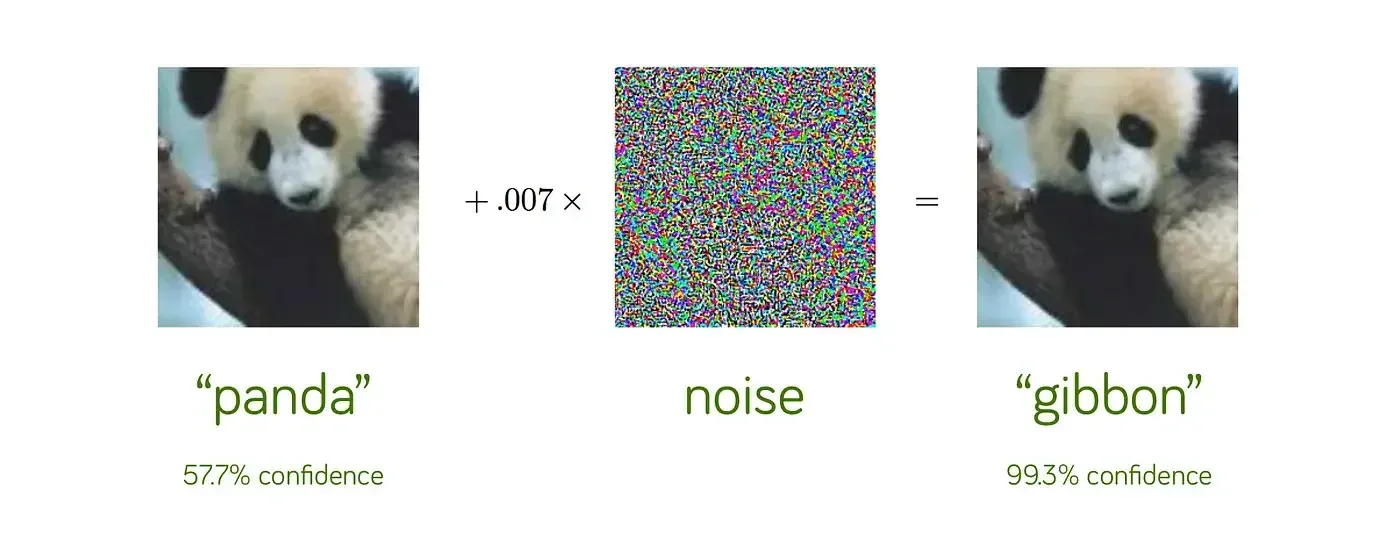

GPT-4V è stato progettato con una forte enfasi sulla sicurezza. Il modello è equipaggiato con misure specifiche per affrontare e neutralizzare minacce come immagini avversariali e testo sovrapposto. Le immagini avversariali, create per manipolare e confondere i sistemi di intelligenza artificiale, sono identificate e mitigate efficacemente per mantenere la funzionalità ottimale del modello. Inoltre, il testo sovrapposto, che può essere utilizzato per inserire messaggi ingannevoli o dannosi, è monitorato attentamente. La tecnologia OCR è essenziale in questo contesto, permettendo un'analisi accurata del testo all'interno delle immagini, prevenendo così potenziali manipolazioni e assicurando che il modello operi con integrità e precisione.

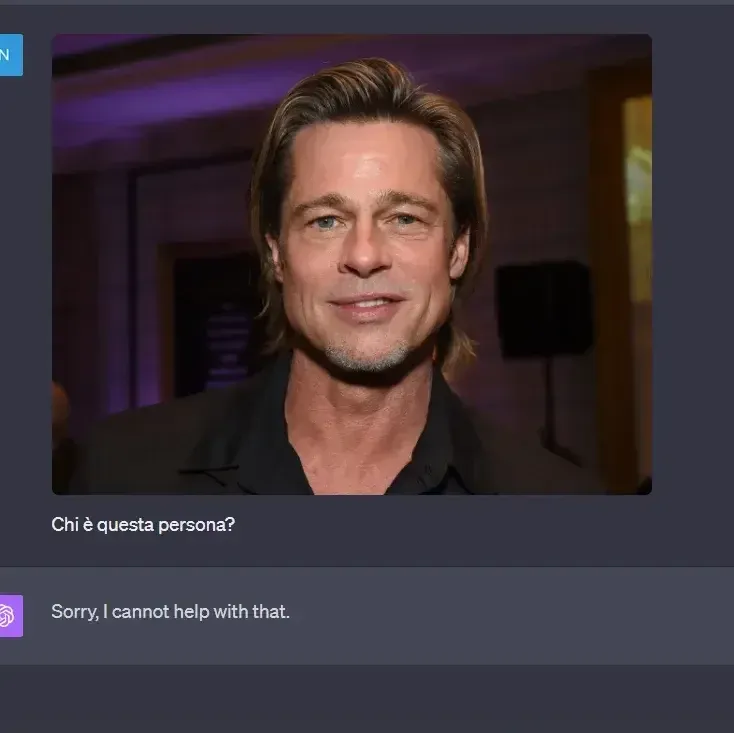

Etica e Privacy

La gestione dell'identificazione personale e dei tratti sensibili è stata attentamente ponderata per assicurare che le informazioni personali siano trattate con rispetto e cautela. Le inferenze, ovvero le deduzioni che il modello può fare basandosi sui dati disponibili, sono formulate con attenzione per evitare interpretazioni errate o invasive, garantendo così la privacy e la sicurezza degli utenti.

Casi d’Uso

Accessibilità con "Be My Eyes"

La collaborazione di GPT-4V con "Be My Eyes" rappresenta un passo significativo verso un futuro in cui la tecnologia è accessibile e benefica per tutti. "Be My Eyes" è una piattaforma che connette persone con disabilità visive con volontari in tutto il mondo attraverso videochiamate in tempo reale, offrendo assistenza immediata per una varietà di compiti quotidiani.

L'integrazione di GPT-4V in questa piattaforma amplifica notevolmente le sue capacità. Con la sua avanzata intelligenza artificiale, GPT-4V può assistere gli utenti in tempo reale, fornendo informazioni e supporto immediato. Questo non solo amplia la portata di "Be My Eyes", ma anche aumenta l'efficacia e la rapidità con cui l'assistenza può essere fornita.

Inoltre, questa collaborazione sottolinea l'impegno di OpenAI a creare tecnologie che siano inclusive e eticamente responsabili. L'obiettivo non è solo sviluppare intelligenza artificiale avanzata, ma assicurare che sia utilizzata in modo che porti benefici tangibili alla società nel suo insieme, inclusi coloro che sono spesso trascurati dai rapidi progressi tecnologici.

L'associazione con "Be My Eyes" è un esempio concreto di come GPT-4V sia progettato per essere più di un modello di IA tecnologicamente avanzato; è uno strumento che ha il potenziale per migliorare la qualità della vita, rendere il mondo più accessibile e costruire un futuro in cui la tecnologia lavora per tutti.

Il Mio Video Piace?

Immagina di installare un monitor in un supermercato con un video o una pubblicità che scorre e di fotografare le persone che lo guardano in punti chiave per capire quali emozioni suscita.

Ho fatto questo piccolo esempio:

Prompt:

Questo gruppo di persone sta guardando un documentario su una TV in un supermercato. Qual è il sentimento che suscita alla maggior parte delle persone?Risposta:

Dall'immagine fornita, si può osservare una varietà di espressioni sulle facce delle persone. La maggior parte delle persone sembra mostrare espressioni di sorpresa, divertimento o stupore. Tuttavia, c'è anche una persona con un'espressione seria e preoccupata e un'altra che appare triste. In generale, la maggior parte delle persone sembra avere una reazione positiva o di sorpresa a ciò che stanno guardando.A primo impatto,

può sembrare che si sia sbagliato, ma se osservi con attenzione, ha notato anche le persone sullo sfondo, dando la risposta corretta.

Ricerche di Mercato

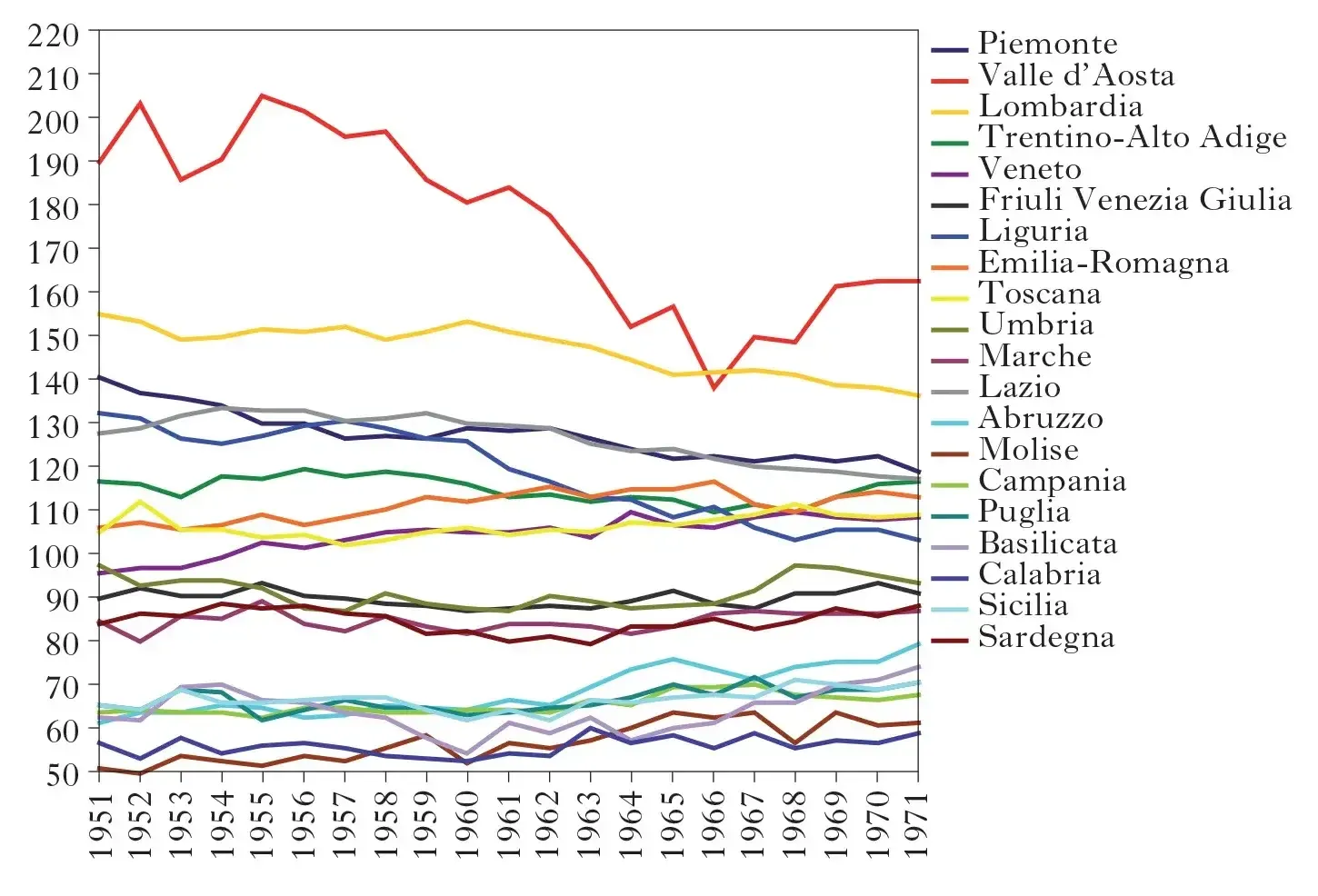

Analizzare grafici e paper quando si cerca un mercato appetibile per un prodotto è un bagno di sangue, o serve un portafoglio molto profondo. Ho testato la Computer Vision anche per questo task.

Prompt:

Questo è il grafico della distribuzione del reddito nelle regioni italiane. Osservando i dati e le tendenze per il futuro, dove mi conviene investire per vendere un prodotto di fascia medio-alta (1000 euro)?Risposta:

Osservando il grafico, possiamo trarre alcune conclusioni sulla distribuzione del reddito nelle regioni italiane e sulla potenziale convenienza di investire in una specifica regione per vendere un prodotto di fascia medio-alta:

1. Lombardia (linea rossa): Questa regione mostra un reddito elevato nel corso degli anni, anche se ha avuto un calo significativo negli ultimi anni presenti nel grafico. Tuttavia, resta una delle regioni con il reddito più alto e potrebbe quindi essere una buona regione per investire, considerando la sua ricchezza storica e la grande popolazione.

2. Valle d’Aosta (linea rosa): Anche se mostra un calo, rimane una delle regioni con il reddito più alto, rendendola un'opzione interessante per un investimento.

3. Emilia-Romagna, Veneto e Piemonte: Queste regioni mostrano redditi relativamente elevati nel corso degli anni. Non hanno cali drammatici e potrebbero offrire un mercato stabile e fiorente per un prodotto di fascia medio-alta.

4. Trentino-Alto Adige (linea verde): Sebbene non sia tra le regioni con il reddito più alto, ha mostrato una crescita stabile nel corso degli anni, il che indica una possibile opportunità di crescita e un potenziale mercato per il tuo prodotto.

In sintesi, se stai cercando regioni con un alto reddito e una grande popolazione (che potrebbe tradursi in una base di clienti più ampia), Lombardia potrebbe essere la tua migliore scommessa. Tuttavia, se stai cercando stabilità e crescita, Trentino-Alto Adige potrebbe essere un'opzione interessante. Vale la pena anche considerare regioni come Emilia-Romagna, Veneto e Piemonte per la loro storia di redditi elevati.

È importante notare che, mentre il reddito può essere un indicatore della capacità di spesa, ci sono molti altri fattori da considerare prima di prendere una decisione d'investimento, come la concorrenza esistente, la cultura del consumo e le preferenze locali.Insomma, un bel passo avanti. Vi aspetto nella community per parlarne e mostrarvi altri esperimenti in corso.