🌅 Benvenuti ad un nuovo appuntamento con AI News 24, la vostra guida giornaliera nel mondo dell’Intelligenza Artificiale, curata da Marketing Hackers. Con un occhio sempre attento alle ultime scoperte e sviluppi, vi aiutiamo a capire meglio le tendenze che stanno plasmando il nostro futuro.

Iscrivetevi a Marketing Hackers e attivate le notifiche per restare sempre al passo con i tempi.

🔎 Oggi esploreremo il vasto panorama dell’IA: la presentazione di Samba-1, un modello AI che gestisce un trilione di parametri, l’uso intelligente dell’AI da parte di DiGiorno per trasformare pizze rotte in coupon digitali, e le previsioni inquietanti/entusiasmanti per l’Intelligenza Artificiale Generale (AGI) e Superintelligente (ASI). Scopriremo inoltre come Hugging Face sta reclutando ingegneri per un progetto di robotica open-source e come il modello Trajectory Consistency Distillation (TCD) sta rivoluzionando la conversione del testo in immagini.

Samba-1: Un Modello AI da Un Trilione di Parametri

SambaNova Systems ha creato Samba-1, un modello di intelligenza artificiale (AI) che gestisce più di un trilione di parametri. Questa novità unisce diversi piccoli modelli specializzati in un unico grande modello, risultando in un sistema molto efficiente. La combinazione con la piattaforma SambaNova apre a prestazioni che si vedono solitamente in modelli da multi-trilione di parametri. È essenziale notare che Samba-1 garantisce la protezione e la privacy dei dati, punti importanti per le aziende. Inoltre, Samba-1 permette aggiornamenti e miglioramenti con facilità, offrendo una versatilità mai vista prima.

Adobe Presenta IA Generativa per Audio Personalizzato

Adobe Research ha dato un’anticipazione del suo Project Music GenAI Control, uno strumento di intelligenza artificiale generativa per creare e modificare audio su misura con comandi testuali.

sviluppato In collaborazione con l’Università della California, San Diego, e la Carnegie Mellon University, lo strumento permette un controllo dettagliato su tempo, struttura, intensità e creazione di loop dell’audio, offrendo un controllo simile a quello di Photoshop per la musica.

Fonte: Adobe Research

(Case Study) DiGiorno Trasforma Pizze Rotte in Coupon Grazie all’AI

Il Pizza Rescue Program di DiGiorno, lanciato in occasione del Giorno del Pi, usa l’intelligenza artificiale per cambiare gli incidenti con le pizze in coupon digitali. Questi buoni, che possono valere da 1 a 2 dollari a seconda del danno, sono dati agli utenti che postano foto delle loro pizze rovinate su un sito dedicato. Kimberly Holowiak, senior brand manager di DiGiorno, ha dichiarato che l’obiettivo è rendere le serate pizza migliori, riducendo il disappunto dei clienti. Questa iniziativa mostra come le aziende stiano ampiamente sfruttando l’AI in questo momento di forte sviluppo dell’intelligenza artificiale generativa.

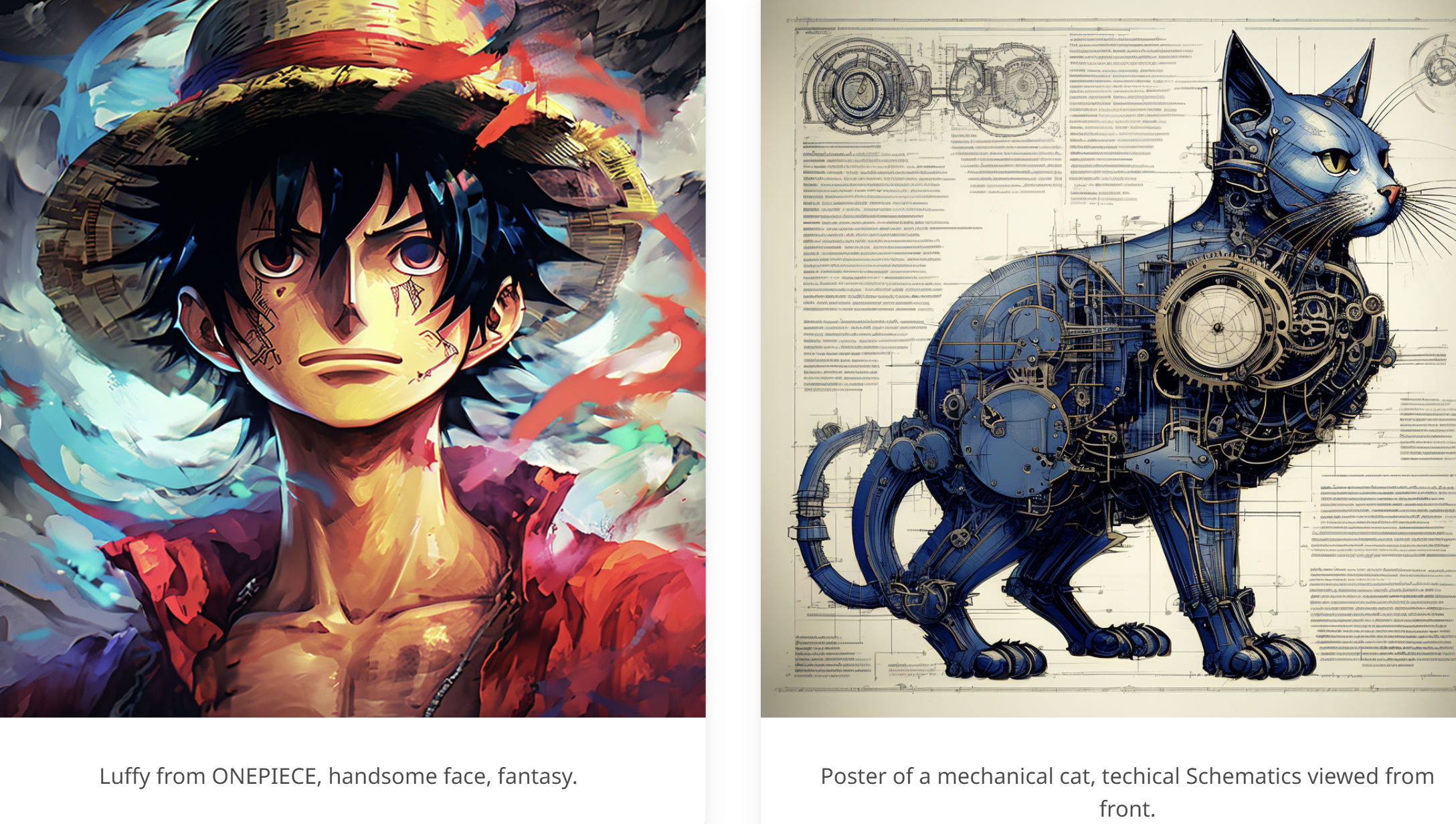

(Nerd Zone!) TCD: Nuovi Orizzonti nella Creazione di Immagini da Testo

Introducendo la Distillazione della Coerenza delle Traiettorie (TCD), si superano le limitazioni del Modello di Coerenza Latente (LCM) nella trasformazione di testo in immagine, migliorando nettamente chiarezza e dettagli delle immagini generate. Utilizzando una funzione di coerenza del percorso e una selezione mirata, diminuisce gli errori e accresce la qualità delle immagini a vari livelli di NFE rispetto al modello precedente. Il ruolo dell’ODE del Flusso di Probabilità nel raffinare l’immagine è essenziale. La TCD perfeziona tre aree principali, dimostrando notevoli progressi nei test, segnando un passo importante nell’evoluzione della conversione testo-immagine.

AGI e ASI: Previsioni entro il 2027

L’Intelligenza Artificiale Generale (AGI) potrebbe essere raggiunta già entro il 2027, trasformandosi in un’Intelligenza Artificiale Superintelligente (ASI), che avrà una conoscenza umana completa. Questo pronostico arriva da Ben Goertzel, il creatore del robot umanoide Sophia, durante il Beneficial AGI Summit. Goertzel afferma che i progressi nei Modelli di Apprendimento del Linguaggio (LLM), come quelli di OpenAI, sono un passo importante verso l’AGI, anche se non bastano da soli per raggiungerlo. Una volta ottenuta l’AGI, questa potrebbe auto-migliorarsi, arrivando a una superintelligenza in pochi anni. Le previsioni di Goertzel coincidono con quelle di altri esperti come Shane Legg e Geoffrey Hinton.

Fonte: Futurism

Hugging Face Avvia Progetto di Robotica Open-Source

Hugging Face, ha annunciato l’avvio di un progetto di robotica open-source. Alla guida Remi Cadene, ex scienziato di Tesla. Cadene ha lavorato per tre anni su Optimus a Tesla e ora punta sull’open-source, diversamente dalle pratiche di Open AI. Sta reclutando ingegneri a Parigi per sviluppare robot reali. Questo segna virata significativa per Hugging Face dal software all’hardware, in un momento di grande interesse per la robotica umanoide e l’AI incorporata. L’obiettivo è portare l’AI dalle schermate alle macchine autonome per compiti fisici vari. Questa iniziativa riflette un trend più ampio nel settore verso l’uso di AI generativa e machine learning per rendere l’addestramento dei robot più efficiente e meno costoso.

Fonte: VentureBeat

Media australiani chiedono risarcimento a Meta per uso di contenuti AI

Le imprese australiane del settore mediatico e informativo potrebbero pretendere un risarcimento da Meta per l’impiego dei loro contenuti nel perfezionamento delle tecnologie di intelligenza artificiale generativa. Tale azione segue la decisione di Meta di cessare i pagamenti per i contenuti notiziari sulle sue piattaforme. L’applicazione del codice di negoziazione dei media informativi potrebbe costringere giganti tecnologici come Meta a indennizzare economicamente per l’uso dei contenuti. Questo scenario si inserisce in una discussione più ampia sull’utilizzo etico di materiale protetto da diritto d’autore per l’addestramento dell’AI, come illustrato dal caso di The New York Times contro OpenAI. Il Centre for Media Transition dell’University of Technology e la Public Interest Journalism Initiative stanno valutando soluzioni e sfide per equilibrare il giornalismo di interesse pubblico con lo sviluppo dell’AI. Si stanno esaminando anche questioni legali e politiche relative al diritto d’autore e all’AI. Si discute inoltre del modello Llama 2 di Meta e della proposta di un nuovo schema da Reset Australia.

Fonte: TheGuardian

Inflection AI Lancia Nuovo Modello per il Chatbot Pi, quasi alla pari con GPT-4

Inflection AI, con base a Palo Alto e co-fondata dai creatori di DeepMind e LinkedIn, ha introdotto Inflection-2.5, un avanzato modello per il suo chatbot Pi. Questo modello sfida direttamente il GPT-4 di OpenAI, mostrando particolare forza nelle materie STEM. Superando le capacità del precedente Inflection-1, Inflection-2.5 è stato allenato con il 40% di FLOPs in meno rispetto a GPT-4 e offre la possibilità di cercare informazioni sul web in tempo reale. L’ambizione di Inflection AI è di rendere Pi un assistente digitale disponibile per tutti, come dimostrano i più di un milione di utenti attivi ogni giorno. Inflection-2.5 ha fatto registrare miglioramenti notevoli nei test, avvicinandosi a GPT-4 con un punteggio MMLU di 85.5 e risultati competitivi negli esami di matematica e fisica. L’obiettivo è quello di unire un’intelligenza avanzata a capacità emotive, per promuovere interazioni più personali e naturali.

Fonte: VentureBeat

“Liberated Qwen", l’AI senza Peli Sulla Lingua

“Liberated Qwen”, creato da Abacus AI, è un nuovo modello linguistico open-source non censurato. È basato su Qwen1.5-72B di Alibaba Group. È stato migliorato usando il dataset SystemChat per seguire al meglio i prompt di sistema. Grazie a questa specificità, è molto utile per usi pratici come i chatbot. Infatti, “Liberated Qwen” ha battuto il miglior modello open-source nei test MT-Bench di HumanEval. Abacus AI non si ferma e vuole potenziare ancora di più le prestazioni in HumanEval. Pianifica di lanciare modelli più evoluti che mescolano le caratteristiche di SystemChat con altri dataset.

Fonte: VentureBeat

EA Prevede AI che scrive Videogiochi e maggiore dipendenza dei fruitori aumentando i Ricavi

Il CEO di Electronic Arts, Andrew Wilson, sostiene che l’intelligenza artificiale generativa potrebbe migliorare l’efficienza di EA del 30% e aumentare i ricavi del 20% nei prossimi cinque anni. Si anticipa una riduzione dei tempi di sviluppo dei videogiochi da sei mesi a sei settimane, e in alcuni casi persino a sei giorni. L’IA generativa ha già reso FIFA 23 più avanzato con 12 cicli di corsa, e EA Sports FC 24 con 1.200 cicli di corsa, arricchendo l’esperienza di gioco. Benché EA abbia dovuto licenziare circa 670 impiegati, Wilson evidenzia come l’IA generativa sia impiegata per arricchire il lavoro umano anziché sostituirlo, in un momento in cui il settore ha registrato 8.000 licenziamenti all’inizio del 2024. Wilson prevede che l’IA generativa incrementerà la base di giocatori di EA, attualmente di 700 milioni, di almeno il 50%, e aumenterà la spesa dei giocatori del 10-20% con contenuti personalizzati.

Fonte: Techspot

Reddit lancia un filtro AI contro le molestie online, verginità di ritorno?

Reddit ha introdotto un nuovo strumento AI chiamato “filtro anti-molestie”. Questa tecnologia usa un Large Language Model addestrato sui dati dei moderatori e sui contenuti eliminati per trovare post molesti. Il filtro aiuta i moderatori a gestire le comunità online, evidenziando post sospetti. I moderatori possono poi decidere se approvare, cancellare o commentare questi post.

Inoltre, Reddit ha annunciato aggiornamenti e nuove funzioni per migliorare l’esperienza degli utenti, in preparazione al suo lancio in borsa. Gli utenti possono attivare il filtro scegliendo tra livelli di sensibilità “Basso” o “Alto”, a seconda della comunità.

Per saperne di più, visita l’articolo originale su Reddit introduces an AI-powered tool that will detect online harassment.

Huawei e il suo Generatore di Immagini 4K

Il modello Diffusion Transformer (DiT) PixArt-Σ sta portando al limite la creazione di immagini di alta risoluzione. Questo modello batte il suo predecessore, PixArt-α, creando immagini 4K molto dettagliate che seguono fedelmente i prompt di testo. Il trionfo di PixArt-Σ si deve a una strategia di addestramento innovativa, partendo da PixArt-α e passando poi a dati di migliore qualità con un metodo ‘da semplice a complesso’. In più, PixArt-Σ introduce un modulo d’attenzione che riduce chiavi e valori, rendendo il modello più efficiente. Con soli 0.6B di parametri, PixArt-Σ supera modelli più grandi come SDXL (2.6B) e SD Cascade (5.1B) per qualità dell’immagine e precisione dei prompt. La sua abilità di produrre immagini 4K apre porte a nuovi livelli di creazione di contenuti visivi per il cinema e i videogiochi. Per ulteriori informazioni, visita il Github

BENlabs Migliora TubeBuddy con Funzioni Avanzate di A/B Testing 🚀

BENlabs, l’azienda che opera nel campo dell’intelligenza artificiale applicata all’entertainment, ha lanciato nuove funzioni di A/B Testing per TubeBuddy. Questa estensione per browser aiuta i creatori su YouTube a migliorare i loro contenuti. A differenza di altre piattaforme che si limitano a considerare il tempo di visione per identificare il contenuto migliore, TubeBuddy permette di basare le scelte su dati solidi, utilizzando metriche come il Click-Thru-Rate e l’Engagement.La versione aggiornata dell’A/B Testing è già a disposizione degli utenti di TubeBuddy e può essere accessibile aggiornando l’estensione al browser alla versione più recente.

🔗 Fonte

Se apprezzi AI News 24, perché non condividerla con il tuo network? Più siamo, più impariamo. Iscriviti e attiva le notifiche per essere sempre aggiornato sulle ultime novità e approfondimenti sull’Intelligenza Artificiale. A domani con nuove entusiasmanti scoperte.